隨著電子商務的蓬勃發展,快遞業務量迅速增長,快遞代取服務成為解決用戶時間不便和物流末端難題的有效途徑。本文探討了基于Spring Boot框架的快遞代取服務系統的設計與實現,旨在提供一個高效、可靠的代領管理平臺。

一、系統需求分析

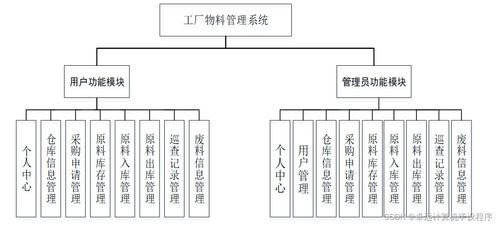

快遞代取服務系統需滿足用戶、代取員和管理員三方的需求。用戶端應支持快遞信息錄入、代取請求提交和狀態追蹤;代取員端需包含任務接收、取件狀態更新和配送管理功能;管理員則負責系統維護、用戶審核和數據統計分析。通過Spring Boot的快速開發特性,系統能夠高效整合這些功能模塊。

二、系統架構設計

本系統采用經典的三層架構:表現層、業務邏輯層和數據訪問層。表現層使用Thymeleaf模板引擎構建用戶界面,實現響應式設計以適應不同設備;業務邏輯層基于Spring Boot的依賴注入和AOP支持,處理核心代取流程,如訂單生成、任務分配和通知推送;數據訪問層利用Spring Data JPA簡化數據庫操作,MySQL作為數據存儲方案,確保數據一致性和安全性。系統集成Redis緩存以提升性能,并采用RESTful API設計增強可擴展性。

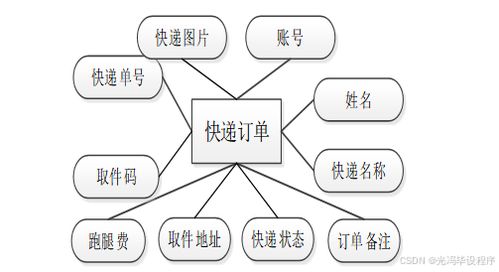

三、核心功能實現

- 用戶模塊:用戶通過注冊登錄后,可添加快遞信息(如快遞單號、取件地址),提交代取請求并實時查看代取進度。Spring Security用于身份驗證和權限管理,保障用戶數據安全。

- 代取員模塊:代取員通過移動端或Web端接收任務,更新取件狀態(如已取件、配送中、已完成),并利用地圖API優化配送路線。系統通過消息隊列(如RabbitMQ)異步處理任務分配,提高并發性能。

- 管理模塊:管理員可監控系統運行狀態,處理用戶投訴和代取員審核,并通過數據可視化工具分析業務指標,如代取效率和用戶滿意度。

四、技術優勢與創新點

Spring Boot框架簡化了配置和部署流程,內嵌Tomcat服務器支持快速啟動。系統結合微服務思想,將代取服務拆分為獨立模塊,便于維護和擴展。創新之處在于智能匹配算法:根據代取員位置和任務優先級自動分配任務,減少等待時間。同時,系統引入積分獎勵機制,激勵代取員提升服務質量。

五、測試與部署

系統通過單元測試和集成測試確保穩定性,使用Docker容器化部署,實現環境一致性。性能測試表明,在高并發場景下,系統響應時間保持在毫秒級,滿足實際應用需求。

六、總結與展望

本系統展示了Spring Boot在快遞代取服務中的高效應用,為計算機技術培訓提供了實踐案例。未來,可引入人工智能技術優化路徑規劃,或集成區塊鏈提升交易透明度,進一步推動物流行業的數字化轉型。